나는 clawdbot(moltbot, openclaw) 에게 얼굴을 선물했다.

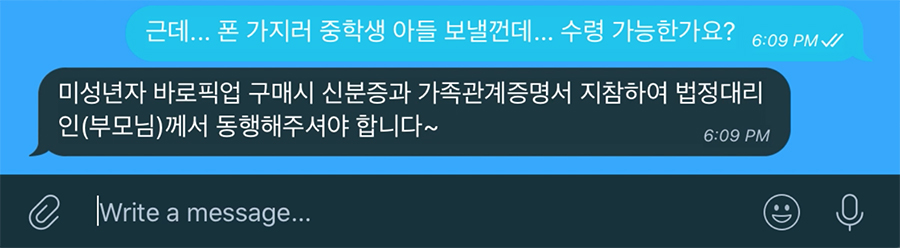

우리가 일반적으로 시스템에 소프트웨어를 설치하고 사용해보면서 이슈가 생기면 소스코드 기반 그 동작원리를 이해하고 직접 해결하거나 구글링 하여 해결 실마리를 찾아서 해결하는 과정이 정석이긴 했다. 그리고 요즘엔 제미나이에 상황과 로그를 주고 해결해 달라고 하는게 정석이 되버렸다. 소프트웨어는 여러 주변 환경에 따라서 영향을 받아 이슈가 생기는 경우가 많다. 그래서 도커를 쓰는거긴 하지만 LLM이 혈액이 되서 동작하는 clawdbot […]

계속 읽기